KI in der Pflege: Was der New Yorker Pflegestreik Deutschland lehren sollte

Kürzlich wurde mir eine Software vorgeführt, die vollautomatisch eine Strukturierte Informationssammlung (SIS) und Pflegemaßnahmen aus Arztberichten und Befunden generiert. Kein Hinweis auf die Validierung der Ergebnisse. Kein Hinweis auf die Fehlerquote. Kein Hinweis darauf, wer die pflegerische Verantwortung für das trägt, was dieses System produziert. Der Vertreter sprach von Effizienz, von Zeitersparnis, von der Zukunft der Pflege. Ich sprach innerlich von einem Problem, das wir in Deutschland noch nicht ernst genug nehmen.

Zeitgleich streikten in New York City rund 15.000 Pflegefachkräfte und zwar nicht nur für bessere Löhne. Sie streikten auch dafür, dass eine Maschine nicht ungeprüft über ihre Arbeit entscheiden darf.

KI-Generiertes Bild: Original https://fortune.com/2026/02/20/new-york-nurses-union-raise-ai-safeguards-deal-longest-strike/

41 Tage Streik — und KI war mittendrin

Am 12. Januar 2026 begannen etwa 15.000 Mitglieder der New York State Nurses Association (NYSNA) den größten und längsten Pflegestreik in der Geschichte New York Citys. Betroffen waren drei der bedeutendsten Krankenhaussysteme der Stadt: NewYork-Presbyterian, Mount Sinai und Montefiore Medical Center. Nach 41 Tagen — bei teils eisigen Temperaturen auf dem Streikposten — ratifizierten die Pflegekräfte neue Dreijahresverträge. Mit 93 Prozent Zustimmung bei NewYork-Presbyterian, mit 87 bis 96 Prozent bei den anderen Häusern.

Die Öffentlichkeit nahm vor allem die Lohnforderungen wahr: mehr als 12 Prozent Gehaltserhöhung über drei Jahre, durchsetzbare Personalquoten, kein Abbau von Krankenversicherungsleistungen. Das alles war wichtig und richtig. Aber es war nicht das Einzige, worum es ging.

Zum ersten Mal in der Geschichte amerikanischer Pflege-Tarifverträge wurden Schutzklauseln für den Einsatz von Künstlicher Intelligenz vertraglich festgeschrieben. Und wer sich die Inhalte dieser Klauseln ansieht, versteht: Hier haben Pflegefachkräfte etwas erkämpft, über das wir in Deutschland noch nicht einmal öffentlich diskutieren.

Was die Pflegekräfte konkret erkämpften

Die vereinbarten KI-Klauseln sind kein vages Bekenntnis zu einer humanen Digitalisierung. Sie sind konkret, durchsetzbar und strukturell bedeutsam:

- Override-Recht (Montefiore): Pflegefachkräfte haben das ausdrückliche vertragliche Recht, ihr klinisches Urteilsvermögen einzusetzen, um KI-generierte Entscheidungen zur Patientenversorgung zu korrigieren oder zu ignorieren. Ein Algorithmus darf die individuelle pflegerische Einschätzung am Krankenbett nicht ersetzen.

- Benachrichtigungspflicht (Mount Sinai): Das Krankenhaus muss die Gewerkschaft benachrichtigen, bevor neue Technologien eingeführt werden, die die Pflegepraxis beeinflussen. KI darf nicht still und leise in den Arbeitsalltag eingeführt werden.

- Prüfungsrecht vor Implementierung: Pflegekräfte haben das Recht, KI-Technologien zu prüfen, bevor sie an Patienten zum Einsatz kommen.

- Verbot der Trainings-Überwachung: Systeme, die Pflegehandlungen aufzeichnen, um Algorithmen darauf zu trainieren, sind vertraglich eingeschränkt. Die tägliche Arbeit der Pflegefachkraft soll nicht zur Datenbasis für ihre eigene Ersetzbarkeit werden.

- Schutz vor virtueller Pflege: Die Verlagerung von Pflegearbeit auf nicht gewerkschaftlich organisierte Fern-Pflegekräfte, die Patienten lediglich über einen Bildschirm betreuen, wird durch die Verträge eingedämmt.

Das Kernprinzip, auf das sich alle diese Klauseln beziehen, formulierte die NYSNA unmissverständlich: „A real nurse at the bedside.“ Eine echte Pflegekraft am Bett des Patienten, das ist nicht verhandelbar.

KI-Generiertes Bild

Der Forschungsstand: Wenig belegt, aber Tendenz erkennbar

Man muss ehrlich sein: Die Forschung zu den Auswirkungen von KI-Systemen auf die Pflegepraxis steckt noch in den Kinderschuhen, auch in den USA. Randomisierte kontrollierte Studien, die zeigen, ob KI-gestützte Pflegeplanung die Versorgungsqualität verbessert oder verschlechtert, fehlen weitgehend. Die Evidenzlage ist dünn.

Was es gibt, sind erste Hinweise, die nachdenklich stimmen sollten. Aus pflegerischer Perspektive wurden in amerikanischen Einrichtungen bereits Systeme eingesetzt, die auf Basis von Algorithmen des maschinellen Lernens Risikoeinschätzungen für Dekubitus, Sturz oder Mangelernährung vornehmen, Assessments also, die traditionell zur Kernkompetenz der Pflegediagnostik gehören. Die Frage, wie diese Systeme bei atypischen Patientenverläufen, bei Menschen mit Demenz oder bei komplexen Multimorbidität versagen, ist kaum untersucht.

Was die amerikanischen Pflegekräfte von ihren deutschen Kolleginnen und Kollegen unterscheidet: Sie haben eine Antwort auf diese Wissenslücke gefunden. Nicht Schweigen, nicht Akzeptanz, sondern vertragliche Schutzräume, bis die Evidenz vorliegt. Das ist ein Ausdruck professioneller Reife, die man nur mit einem hohen Grad an akademischer Fundierung und gewerkschaftlicher Organisation erreichen kann.

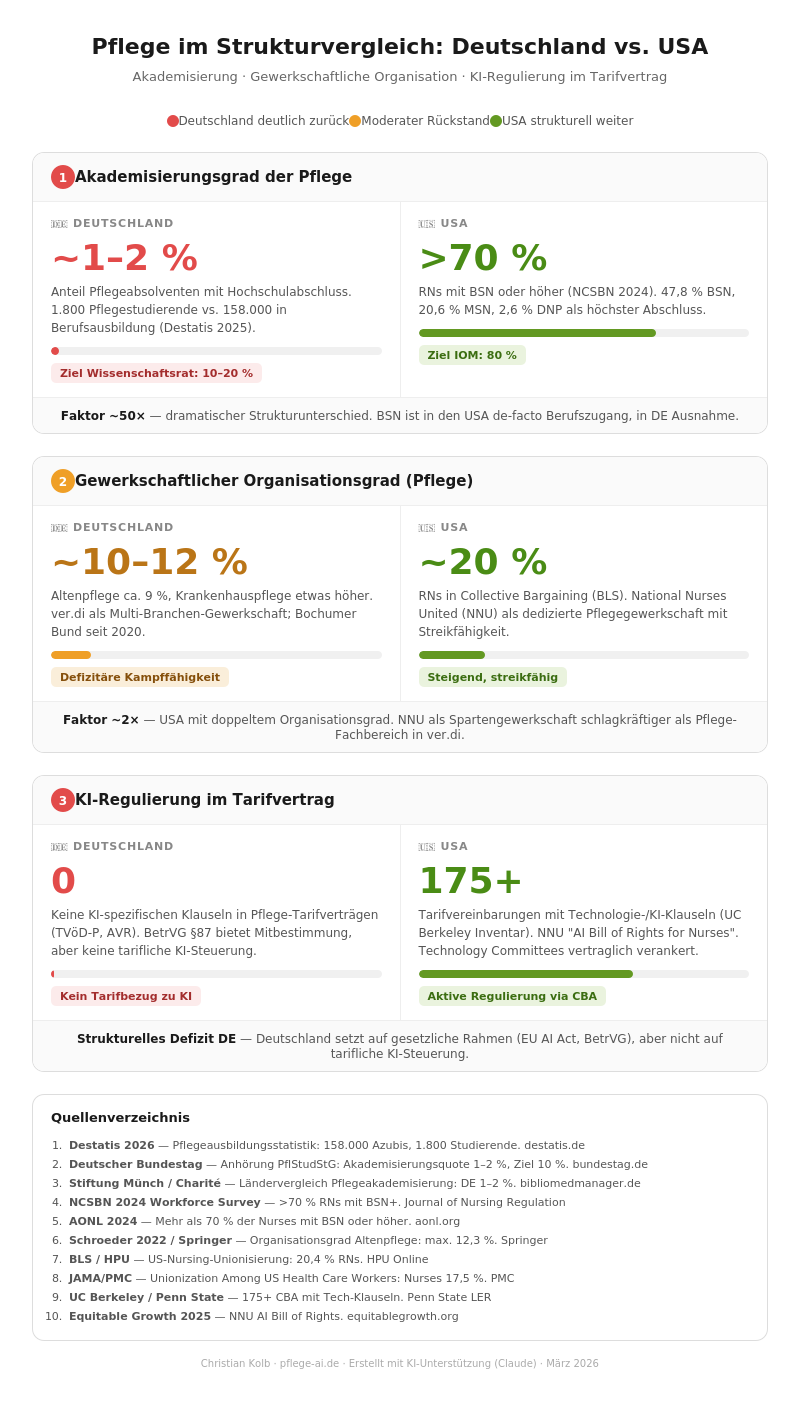

In den USA ist die Akademisierung der Pflege deutlich weiter fortgeschritten als in Deutschland. Der Bachelor of Science in Nursing (BSN) ist seit Jahren der Standard für den Berufseinstieg an vielen Einrichtungen; der Anteil von Pflegekräften mit Masterabschluss oder Promotion wächst kontinuierlich. Diese Fachkräfte haben das Rüstzeug, um KI-Systeme kritisch zu hinterfragen, sie wissen, was ein Algorithmus kann und was nicht, sie kennen die Grenzen maschinellen Lernens, und sie verstehen, warum pflegerisches Urteilsvermögen nicht auf Trainingsdaten reduziert werden kann.

Und Deutschland? Eine unbequeme Bestandsaufnahme

Ich verfolge in den letzten Monaten immer wieder KI-gestützte Softwarelösungen, die auf dem deutschen Pflegemarkt angeboten werden oder kurz vor der Markteinführung stehen, bzw. verfolge die Diskussionen. Die Bandbreite ist beeindruckend, alle arbeiten mit Hochdruck an den Lösungen zur KI-gestützten Planung der Pflegemaßnahmen und Dokumentation, aber auch beunruhigend zugleich.

Da ist die bereits erwähnte Software, die aus Arztberichten und Befunden automatisch eine SIS und Pflegemaßnahmen generiert. Die SIS — die Strukturierte Informationssammlung — ist in der deutschen ambulanten und stationären Langzeitpflege das zentrale Instrument der Pflegeplanung. Sie bildet die individuelle Lebenssituation eines pflegebedürftigen Menschen ab, erfasst seine Ressourcen und seinen Unterstützungsbedarf, und ist die Grundlage für die gesamte Pflegeplanung. Wenn ein Algorithmus dieses Instrument automatisch befüllt, auf Basis von Befunden, die möglicherweise Monate alt sind, die keine Aussage über die tatsächliche Alltagskompetenz treffen, die den Menschen nicht kennen, dann stellt sich die Frage: Wer trägt die fachliche Verantwortung?

Kein Hinweis auf Validierung. Kein Hinweis auf Fehlerquoten. Kein Hinweis darauf, was passiert, wenn das System eine Risikokonstellation übersieht.

Man wird den Eindruck nicht los, dass hier Effizienz vor Sorgfalt gestellt wird und dass die Pflegepraxis dabei als Abnehmer eines Produkts behandelt wird, dessen Qualitätssicherung niemand einfordert.

„70 Prozent der Pflegedokumentation durch KI“ — eine Ansage mit Sprengkraft

Bundesgesundheitsministerin Frau Warken hat KI als Entlastungsinstrument für die Pflege ins Gespräch gebracht. Bis zu 70 Prozent der Pflegedokumentation soll in wenigen Jahren durch KI ersetzt werden.

Ich will diese Aussage nicht pauschal verwerfen. Ja, ein erheblicher Teil der Dokumentationsarbeit in der Pflege ist repetitiv, zeitaufwändig und bindet Ressourcen, die am Patienten fehlen. Wenn KI dabei helfen kann, diesen Anteil zu reduzieren, ohne die Qualität zu gefährden, dann ist das grundsätzlich begrüßenswert.

Aber: Aus A folgt nicht zwingend B. Dass eine Technologie könnte, heißt nicht, dass sie es ohne Qualitätssicherung, ohne Validierungsstudien, ohne Beteiligung der Pflegenden darf. Und die Frage, was mit den verbleibenden 30 Prozent ist, dem Kern des pflegerischen Assessments, der Beziehungsarbeit, der klinischen Einschätzung, bleibt in solchen Szenarien meist unbeantwortet.

Die entscheidende Frage ist nicht, ob KI 70 Prozent der Dokumentation übernehmen kann. Die entscheidende Frage ist: Wer überprüft, ob das, was die KI produziert, dem Patienten gerecht wird?

Wird sich die deutsche Pflege wehren — und kann sie es überhaupt?

Hier wird es unbequem. Denn die ehrliche Antwort lautet: Noch nicht. Noch nicht so, wie es nötig wäre.

Die strukturellen Voraussetzungen für eine fundierte, kollektive Gegenwehr gegen ungeprüfte KI-Systeme fehlen in Deutschland weitgehend:

- Akademisierungsgrad: Der Anteil von Pflegefachkräften mit Hochschulabschluss liegt in Deutschland nach wie vor im einstelligen Prozentbereich. Die Mehrzahl der in der Praxis tätigen Pflegekräfte verfügt nicht über die methodische Ausbildung, um KI-Systeme kritisch zu evaluieren, nicht weil es ihnen an Intelligenz fehlt, sondern weil diese Kompetenzen nicht Teil ihrer Ausbildung waren.

- Gewerkschaftliche Organisationsgrad: Die Tarifbindung in der Pflege ist in Deutschland, trotz Fortschritten durch die Pflegemindestlohnkommission, im internationalen Vergleich schwach. Die Möglichkeit, KI-Governance vertraglich durchzusetzen, wie es NYSNA in New York gelungen ist, fehlt strukturell.

- Fehlendes Problembewusstsein: Viele Pflegekräfte erleben KI noch als abstrakte Zukunftstechnologie, nicht als etwas, das bereits heute ihre Arbeit verändert. Das wird sich ändern, wenn die ersten Systeme flächendeckend eingeführt werden. Dann aber ist es zu spät für vertragliche Schutzklauseln.

Das ist kein Vorwurf an die Pflegenden. Es ist eine Bestandsaufnahme eines Systems, das in der Akademisierung der Pflege jahrzehntelang gespart hat, und das jetzt die Rechnung präsentiert bekommt.

Mit Sonnet 4.6. KI-Generierte Infografik

Was wir aus New York lernen können — fünf konkrete Lektionen

Der NYSNA-Streik ist kein amerikanisches Kuriosum. Er ist ein Präzedenzfall, der zeigt, wohin die Reise geht und welche Weichen jetzt gestellt werden müssen. Hier sind fünf Lektionen, die ich für die deutsche Pflege daraus ableite:

- KI-Governance muss vor der Einführung beginnen, nicht danach. Die amerikanischen Pflegekräfte haben das Recht erstritten, neue Technologien vor der Implementierung zu prüfen. In Deutschland müssen wir dieses Prinzip, Mitsprache vor Rollout, in Betriebsvereinbarungen, Qualitätsmanagement-Strukturen und Vergabeentscheidungen verankern.

- Klinisches Urteilsvermögen ist nicht verhandelbar. Jedes KI-System, das Pflegediagnosen, Pflegeplanungen oder Risikoeinschätzungen produziert, muss mit einem klaren Override-Recht verbunden sein. Die Pflegefachkraft entscheidet, die KI liefert Input, keine Entscheidung.

- Qualitätssicherung muss eingefordert werden. Anbieter von KI-gestützten Dokumentationssystemen müssen verpflichtet werden, Validierungsstudien vorzulegen. Keine Einführung ohne Evidenz. Das gilt für Pflegehilfsmittel, es muss auch für Software mit KI gelten.

- Akademisierung ist kein Luxus, sondern Schutzfaktor. Die Erfahrungen aus den USA zeigen: Je höher der Akademisierungsgrad der Pflegenden, desto fundierter ihre Fähigkeit, KI-Systeme kritisch zu bewerten. Die Investition in hochschulische Pflegeausbildung ist auch eine Investition in den Schutz der Patientenversorgung.

- Gewerkschaftliche und berufspolitische Organisationen müssen KI-Governance zum Thema machen. ver.di, der Deutsche Pflegerat, der DBfK, usw., sie alle müssen KI-Schutzklauseln auf die Agenda setzen, bevor die Systeme flächendeckend eingeführt sind. Danach ist das Verhandlungsfenster geschlossen.

Fazit: Die Frage ist nicht ob, sondern wie

Ich bin kein KI-Skeptiker. Wer meinen Blog kennt, weiß das. Ich glaube an das Potenzial von KI, repetitive und zeitfressende Aufgaben zu übernehmen und damit Pflegekräften den Rücken freizuhalten für das, was keine Maschine kann: die direkte, menschliche, empathische Begegnung mit dem pflegebedürftigen Menschen.

Aber ich war auch Pflegewissenschaftler. Und als solcher weiß ich: Eine Technologie, die in einem der sensibelsten Versorgungsbereiche eingesetzt wird, braucht mehr als ein gutes Marketing-Versprechen. Sie braucht Evidenz. Sie braucht Transparenz. Sie braucht die Stimme derer, die mit ihr arbeiten müssen und die Verantwortung tragen, wenn sie versagt.

Die New Yorker Pflegekräfte haben gezeigt, dass dieser Anspruch durchsetzbar ist, wenn man bereit ist, dafür einzustehen. 41 Tage lang, bei minus zehn Grad, vor dem Eingang eines der reichsten Krankenhaussysteme der Welt.

Die Frage, die sich mir stellt: Wann stellt die deutsche Pflegebranche, Verbände, Gewerkschaften, Wissenschaft, Praxis, die gleichen Fragen? Nicht nach dem Rollout. Jetzt.

Merksatz: KI in der Pflege ist kein Selbstzweck und kein Sparinstrument. Sie ist ein Werkzeug und wie jedes Werkzeug muss sie von denen beherrscht werden, die damit arbeiten, nicht umgekehrt.

Quellen

- New York State Nurses Association (NYSNA): After 41 Days, Historic Nurse Strike Ends. Pressemitteilung, 22. Februar 2026. https://www.nysna.org/press/after-41-days-historic-nurse-strike-ends

- New York State Nurses Association (NYSNA): A „Virtual“ Attack on Our Union Voice. New York Nurse, 2025. https://www.nysna.org/new-york-nurse/virtual-attack-our-union-voice

- Marcelo P, Peltz J, The Associated Press: New York nurses union wins 12% raise, AI safeguards in a tentative deal to end monthlong strike. Fortune, 20. Februar 2026.

- Gothamist: Striking NYC nurses reach tentative contract agreements at Mt. Sinai and Montefiore. 9. Februar 2026. https://gothamist.com/news/striking-nyc-nurses-reach-tentative-contract-agreements-at-mt-sinai-and-montefiore

- Prism Reports: NYC nurses strike sees wins, but some say contracts fall short. 4. März 2026. https://prismreports.org/2026/03/04/nurses-strike-contracts/

- Aiken LH et al.: Educational levels of hospital nurses and surgical patient mortality. JAMA 2003; 290(12):1617–1623.

- Bundesministerium für Gesundheit: Pflegereform und Digitalisierung — Eckpunkte zur KI-gestützten Pflegedokumentation. Berlin 2025.

0 Kommentare