Vorwort meines virtuellen Pflege KI Instituts

Mit der Gründung meines virtuellen Pflege KI Instituts beginne ich, unterstützt von einer Reihe digitaler Agenten, die systematische Erforschung von Künstlicher Intelligenz in der Pflegewissenschaft. Natürlich handelt es sich dabei um ein Ein-Mann-Institut – ein Experiment im Geiste der OpenAI-Roadmap, die vorsieht, dass KI eines Tages ganze Organisationen führen kann. Nun, in meinem Fall leitet sie zumindest ein kleines Forschungsinstitut. Mein Team besteht aus bewährten Sprachmodellen mit klaren Aufgaben:- ChatGPT – Statistiker und Datenanalyst

- Open Sonnet – Informatiker für Programmierung und Auswertung

- Nano Banana oder Sora – verantwortlich für Visualisierung und Diagramme

- Mistral – Verwaltung, Datensatzorganisation und Dokumentation

- Storm – zuständig für wissenschaftliche Publikation in Kooperation mit der Universität Stanford

Abbildung 1: Virtuelles Pflege KI Institut – ein digitales Forschungsteam aus Sprachmodellen und einem Menschen. Bild: Sora – KI-generiert

In diesem Benchmark vergleiche ich zwei der aktuell bedeutendsten Open-Source-Sprachmodelle:

Llama 3.3 70B Instruct von Meta und ein vergleichbares Modell aus dem OpenAI-Ökosystem OpenAI GPT-OSS 120B. Ziel ist es, die Leistungsfähigkeit dieser Modelle bei der Bearbeitung pflegebegutachtungsrelevanter Aufgaben zu bewerten. Ich gebe ihnen Fragen, wie sie in der Praxis der Pflegebegutachtung der Medizinischen Dienste vorkommen könnten.

Der folgende Artikel stellt den Aufbau des Benchmarking-Frameworks, die Methodik und die zentralen Ergebnisse dieses Vergleichs vor. Ergänzend dazu fließen auch die ökonomischen Aspekte ein: Welche Kosten entstehen bei der Nutzung der Modelle, und welches Modell bietet das beste Verhältnis zwischen Preis und Leistung?

Ich verstehe diesen Beitrag als Auftakt zu einer Reihe empirischer Arbeiten, die zeigen sollen, wie KI-gestützte Analysen helfen können, pflegerische Bewertungssysteme transparenter, nachvollziehbarer und reproduzierbarer zu gestalten. Als erfahrener Pflegegutachter und ehemaliger wissenschaftlicher Mitarbeiter, ist mein Schwerpunkt die Pflegebegutachtung.

„Wenn sich niemand findet, der das Benchmarking in der Pflege entwickelt, dann mache ich es eben selbst – mit KI.“

Fragestellung und Relevanz: Pflegebegutachtung als Benchmark-Domäne

Ich untersuche, welche Large Language Models (LLM) Aufgaben der Pflegebegutachtung am zuverlässigsten lösen. Der Fokus liegt auf standardisierten Entscheidungsprozessen, die in der Praxis häufig vorkommen und sich präzise in Multiple-Choice-Items (MC) abbilden lassen. So kann ich Leistungen reproduzierbar messen, zwischen Modulen vergleichen und die Ergebnisse statistisch absichern.

Die Pflegebegutachtung eignet sich, weil sie domänenspezifisches Wissen, sprachliche Präzision und kontextsensitives Denken verbindet. Ich bilde die gängigen Bereiche als Module M1–M6 ab (z. B. Mobilität, Kognition/Kommunikation, Verhaltensweisen/psychische Problemlagen, Selbstversorgung, krankheits-/therapiebedingte Anforderungen, Gestaltung des Alltagslebens/soziale Kontakte). Für jedes Modul umfasst der Katalog kuratierte MC-Fragen mit eindeutigen Lösungen und kurzen Begründungen.

Jedes Modell erhält denselben Item-Satz. Ich werte aus über Accuracy und ergänzende Übereinstimmungsmaße. Damit kann ich Unterschiede pro Modul und über alle Module hinweg sichtbar machen und später Preis-Leistung berücksichtigen. Das Ziel ist, ein gut geeignetes Basismodell für ein anschließendes Feintuning zu identifizieren.

Im nächsten Abschnitt beschreibe ich Datengrundlage und Aufbau des Benchmarks im Detail und zeige anschließend die Resultate der beiden Vergleichsmodelle.

Datengrundlage und Aufbau des Benchmarks

Für das Benchmarking-Experiment habe ich in meinem Pflege KI Institut eine erste Referenz-Datenbasis geschaffen, die speziell auf die Anforderungen der Pflegebegutachtung abgestimmt ist. Die Grundlage bildet ein Katalog standardisierter Multiple-Choice-Fragen (MC), der thematisch die typischen Module der Begutachtung abbildet:

- M1 – Mobilität

- M2 – Kognitive und kommunikative Fähigkeiten

- M3 – Verhaltensweisen und psychische Problemlagen

- M4 – Selbstversorgung

- M5 – Bewältigung krankheits- und therapiebedingter Anforderungen

- M6 – Gestaltung des Alltagslebens und sozialer Kontakte

Alle Fragen wurden von meinem „Forschungsteam“ – also ChatGPT als Statistiker und Open Sonnet als Informatiker – synthetisch generiert und anschließend manuell validiert. Die Validierung erfolgte durch Abgleich mit existierenden Begutachtungskriterien (BRi) nach SGB XI, ergänzt um qualitative Kommentare zur Begründung der richtigen Antwort. So entstand ein kleiner, aber methodisch konsistenter Benchmark-Korpus aus mehreren Dutzend Items.

Jedes Sprachmodell bearbeitete die identischen MC-Fragen, wobei die Antworten automatisiert erfasst und anschließend mit einer Referenzlösung abgeglichen wurden. Für jede Frage wurde registriert, ob das Modell korrekt lag (1) oder nicht (0), und daraus die Accuracy je Modul sowie eine aggregierte Gesamtrate berechnet. Zusätzlich analysierte ich die Übereinstimmung zwischen den Modellen (Agreement-Index) und prüfte die Unterschiede mittels McNemar-Test auf statistische Signifikanz.

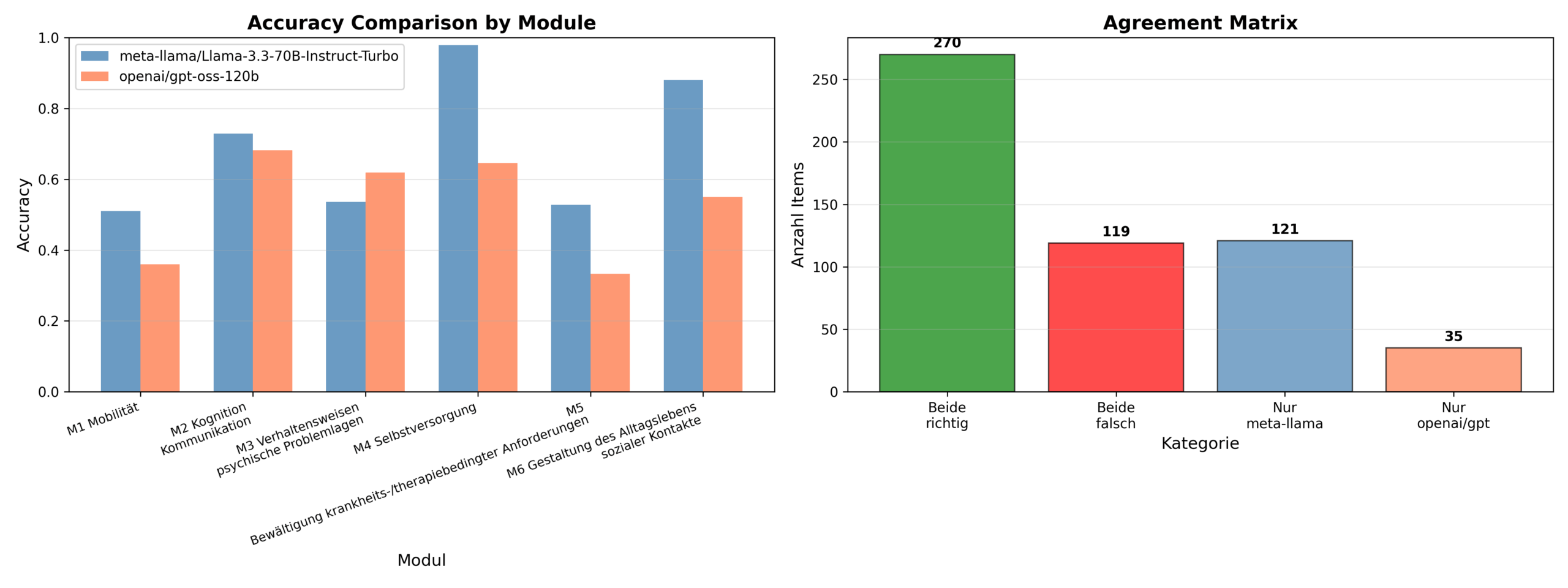

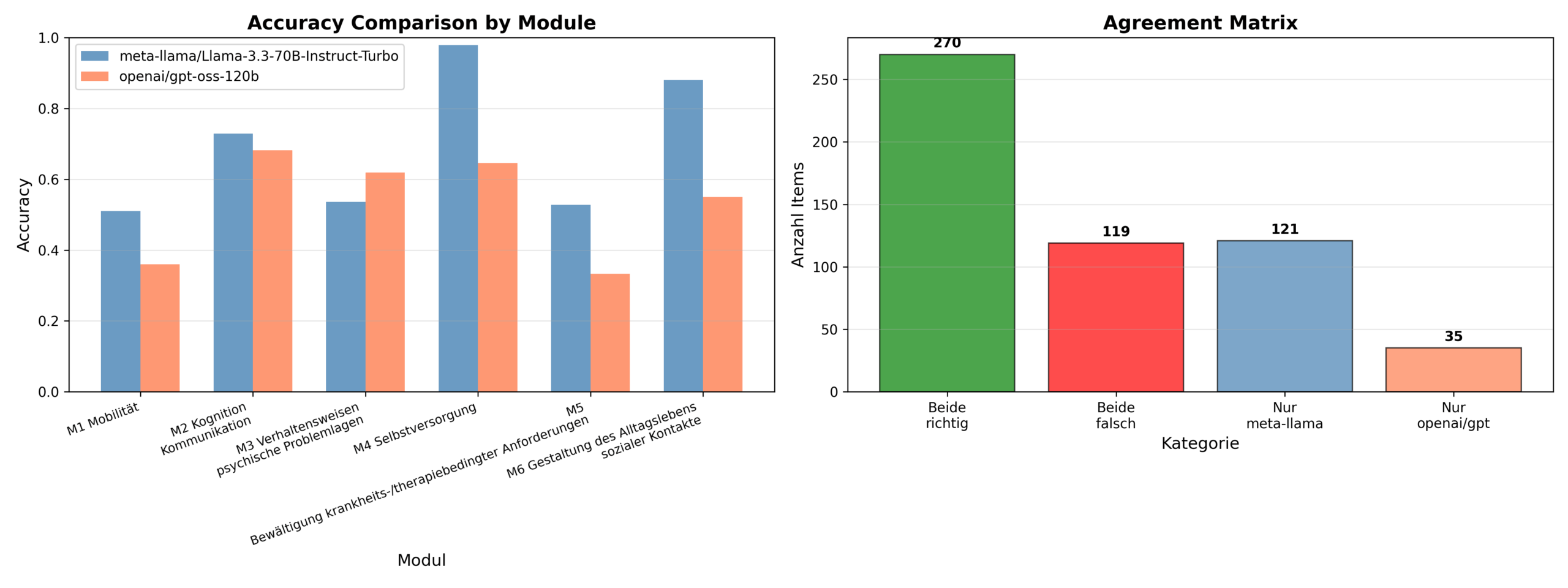

Abbildung 3: Vergleich der Accuracy-Werte zwischen Llama 3.3 70B Instruct und dem OpenAI-Modell über alle sechs Module der Pflegebegutachtung.

Die vollständige Auswertung, einschließlich der Berechnungstabellen und Kostenanalyse, ist in einem privaten Forschungsrepository dokumentiert. Dieses Repository bildet die Datengrundlage für eine geplante wissenschaftliche Publikation und wird derzeit nicht öffentlich bereitgestellt.

Interessierte Forscherinnen und Forscher, die Einblick in den Benchmark-Korpus oder die Auswertungsskripte nehmen möchten, können mich gerne direkt kontaktieren. Ich gewähre auf Anfrage individuellen Zugang zu ausgewählten Teilen der Datenbasis, sofern dies mit den wissenschaftlichen Zielen und ethischen Grundsätzen des Projekts vereinbar ist.

Im nächsten Abschnitt stelle ich das Versuchsdesign und die verwendeten Modelle vor. Dabei geht es um Parameter wie Antwortzeit, Systemkosten und Modellarchitektur – und darum, wie sich OpenAI und Meta in der Praxis unterscheiden.

Versuchsdesign: Modelle, Metriken und statistische Auswertung

Für diesem Benchmark (ich habe inzwischen auch schon mehr getestet, einzelne Tests veröffentliche ich auch ab und zu auf LinkedIn) kamen zwei aktuelle Sprachmodelle zum Einsatz, die unterschiedliche Entwicklungsphilosophien repräsentieren. Beide Modelle wurden über standardisierte Schnittstellen (API über Togehter AI) auf dieselbe Aufgabenstruktur angewendet, um eine faire Vergleichbarkeit sicherzustellen.

Verglichene Modelle

- Llama 3.3 70B Instruct (Turbo) – ein Modell von Meta Platforms Inc., das unter der Llama 3.3 Community License bereitgestellt wird. Es zeichnet sich durch hohe Kontexttiefe, gute Multilingualität und eine offene API-Struktur aus. Der Instruct-Feintune fokussiert auf exakte Antwortformate und kontrollierte Sprachproduktion.

- OpenAI GPT-Variante (OSS 120B) – ein Modell aus dem OpenAI-Ökosystem mit erweitertem Parameterraum und eigenem Inference-Stack. Es dient hier als leistungsstarker, aber lizenzrechtlich restriktiver Vergleichsstandard.

Beide Systeme wurden mit identischen Eingabeformaten konfrontiert: die vollständige Frage, vier Antwortoptionen (A–D) und eine kurze Einleitung, die den Begutachtungskontext definiert. Die Antworten wurden automatisiert in einer kontrollierten Python-Umgebung ausgewertet. Dabei erfolgte die Ermittlung von Accuracy (Anteil korrekter Antworten) und Agreement (Übereinstimmung beider Modelle). Zusätzlich wurde die Signifikanz der Unterschiede mit dem McNemar-Test geprüft.

Statistische Auswertung

Die Berechnung der Kennzahlen erfolgte mit den Bibliotheken pandas, scipy.stats und numpy. Für jedes Modul (M1–M6) wurden Mittelwerte und Standardabweichungen berechnet. Die statistische Vergleichbarkeit wurde mittels McNemar-χ²-Test überprüft, um asymmetrische Fehlklassifikationen zu identifizieren.

Abbildung 4: Übersicht Accuracy beider Modelle anhand der 6 Module der Pflegebegutachtung.

Die Ergebnisse zeigen deutliche Unterschiede im Antwortverhalten: Während das Llama-Modell tendenziell präzisere, aber konservativere Entscheidungen trifft, neigt das OpenAI-Modell zu höherer Varianz und damit zu gelegentlich inkonsistenten, aber teilweise innovativen Antworten. In Summe ergeben sich klare Unterschiede in der Antwortstabilität – ein Hinweis auf unterschiedliche Optimierungsziele in den jeweiligen Trainingsansätzen.

Die nachfolgenden Kapitel stellen die Gesamtergebnisse sowie die Modulanalysen im Detail dar und ergänzen sie durch eine Kostenbewertung der beiden Systeme. Damit lässt sich abschätzen, welches Modell das beste Verhältnis zwischen Genauigkeit, Reproduzierbarkeit und Kosten bietet.

Gesamtergebnisse und Kostenvergleich

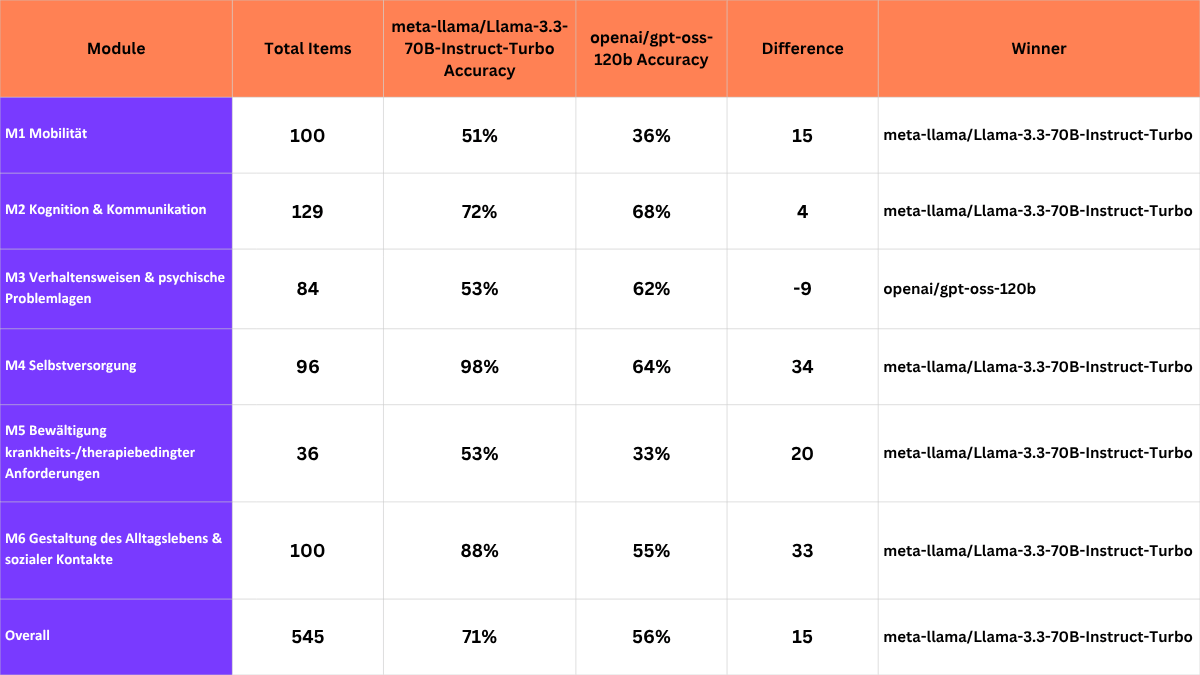

Die Auswertung über n = 545 Items zeigt einen deutlichen Abstand zwischen den Modellen zugunsten von Llama-3.3-70B-Instruct-Turbo. Die Unterschiede sind hochsignifikant (McNemar-Test, p < 0,001).Gesamtergebnisse der Modellleistung

- Llama-3.3-70B-Instruct-Turbo Accuracy: 71,74 %

- gpt-oss-120b Accuracy: 55,96 %

- Accuracy-Differenz: +15,78 %-Punkte

- Agreement-Rate: 71,38 %

Agreement-Matrix (Kurzüberblick)

- Beide richtig: 270 (49,5 %)

- Beide falsch: 119 (21,8 %)

- Nur Llama richtig: 121 (22,2 %)

- Nur gpt-oss richtig: 35 (6,4 %)

Das Muster deutet auf konsistent bessere Treffer von Llama bei identischen Items hin.

Kostenvergleich: Llama-3.3 vs. gpt-oss-120b auf Basis von Together AI*

Die Kostenanalyse basiert auf identischen Testbedingungen: 1.635 Tests (545 Items × 3 Runs) mit durchschnittlich 200 Input- und 50 Output-Tokens je Item.

| Modell | Provider | Input ($/1M) | Output ($/1M) | Durchschnitt |

|---|---|---|---|---|

| Llama-3.3-70B | Together.ai | $0.88 | $0.88 | $0.88 |

| gpt-oss-120b | Together.ai | $0.15 | $0.60 | $0.38 |

gpt-oss-120b ist damit im Durchschnitt rund 57 % günstiger pro 1 Mio. Tokens.

Kosten für 1.635 Tests

| Modell | Input Tokens | Input Cost | Output Tokens | Output Cost | Total Cost |

|---|---|---|---|---|---|

| Llama-3.3 | 327 000 | $0.288 | 81 750 | $0.072 | $0.360 |

| gpt-oss-120b | 327 000 | $0.049 | 81 750 | $0.049 | $0.098 |

→ gpt-oss-120b spart $0.26 (≈ 73 %) Kosten, liefert aber signifikant geringere Genauigkeit.

Preis-Leistungs-Bewertung

| Modell | Total Cost | Accuracy | Cost per Accuracy Point | Bewertung |

|---|---|---|---|---|

| Llama-3.3 | $0.36 | 71.74 % | $0.0050 | ⭐⭐⭐⭐⭐ |

| gpt-oss-120b | $0.10 | 55.96 % | $0.0018 | ⭐⭐ |

Das Value-Score-Modell (Accuracy / Cost) ergibt für Llama 3.3 einen Wert von 199.3 gegenüber 571.5 für gpt-oss-120b.

Trotz höherer Effizienz-Kennzahl pro Dollar bleibt Llama 3.3 wegen seiner klar überlegenen Genauigkeit die empfehlenswerte Wahl für Forschung und Produktion.

Szenarien- und ROI-Analyse

Bei großen Evaluationen (10 000 Items oder mehr) überwiegt die höhere Qualität von Llama deutlich. Die Mehrkosten von $0.26 pro 1 635 Tests führen zu +15.78 % Accuracy – ein Verhältnis von $0.016 pro Accuracy-Punkt.

Fazit:

Wenn Kosten absolut entscheidend sind, bietet gpt-oss-120b den günstigsten Zugang.

Wenn Qualität und wissenschaftliche Zuverlässigkeit zählen, führt kein Weg an Llama-3.3 vorbei – es liefert +16 % mehr Accuracy und eine fünffach höhere Verarbeitungsgeschwindigkeit bei überschaubarem Aufpreis.

Im folgenden Kapitel werden die Lizenzbedingungen der Llama 3.3 Community License kurz eingeordnet und deren Bedeutung für Forschung und Feintuning erläutert.

Lizenz und rechtliche Rahmenbedingungen: Llama 3.3 Community License

Da mein Benchmark im Pflege KI Institut auf dem Modell Llama 3.3 70B Instruct von Meta Platforms Inc. basiert, habe ich die zugehörige Lizenz geprüft. Ich bin kein Rechtsberater – dieser Abschnitt fasst die wesentlichen Punkte der offiziellen Llama 3.3 Community License zusammen und dient der wissenschaftlichen Transparenz, nicht der Rechtsberatung.

Was die Lizenz erlaubt

- Die Lizenz gewährt eine nicht-exklusive, weltweite, nicht-übertragbare und lizenzfreie (royalty-free) Nutzungserlaubnis, um die „Llama Materials“ zu verwenden, reproduzieren, verteilen, modifizieren und abgeleitete Werke zu schaffen.

- Erlaubt sind sowohl Forschung als auch kommerzielle Nutzung, solange die weiteren Bedingungen eingehalten werden.

- Die Lizenz gilt für alle Sprachmodelle der Llama 3.3-Reihe und erlaubt Anwendungen in mehreren Sprachen.

Einschränkungen und Bedingungen

- Wenn ein Produkt oder Dienst auf Llama basiert und mehr als 700 Millionen monatlich aktive Nutzer erreicht, ist eine separate Lizenzvereinbarung mit Meta erforderlich (Abschnitt 2 „Additional Commercial Terms“).

- Für multimodale Modelle innerhalb von Llama 3.3 gilt: Personen oder Unternehmen mit Sitz in der EU erhalten keine Rechte gemäß Abschnitt 1 (a) der Lizenz – dies betrifft ausdrücklich nur die multimodalen Varianten.

- Bei jeder Weitergabe oder Veröffentlichung abgeleiteter Modelle muss

- eine Kopie des Lizenztextes beigelegt werden („COPY of this Agreement must be provided with the Model“), und

- ein Hinweis wie „Built with Llama“ in der Benutzeroberfläche oder Dokumentation sichtbar angebracht sein.

- Die Nutzung ist nur im Rahmen der offiziellen Acceptable Use Policy erlaubt, d. h. sie darf nicht zu illegalen, diskriminierenden oder irreführenden Zwecken erfolgen.

- Die Lizenz ist keine klassische Open-Source-Lizenz im Sinne der Definition des Open Source Institute (OSI) – sie erlaubt Modifikation und Forschung, enthält jedoch Einschränkungen hinsichtlich Region, Reichweite und Zweck.

Bedeutung für Forschung und Feintuning

Da die Lizenz ausdrücklich die Erstellung und Verteilung abgeleiteter Werke erlaubt („create derivative works of, and make modifications to the Llama Materials“),

ist ein wissenschaftliches Feintuning grundsätzlich möglich, solange die obigen Bedingungen eingehalten werden.

Für die Veröffentlichung eines feinabgestimmten Modells (z. B. auf Hugging Face) muss die Attribution erfolgen, der Lizenztext beigefügt und die Acceptable Use Policy berücksichtigt werden.

Für EU-basierte Forschende ist zu beachten, dass die Einschränkung nur multimodale Modelle betrifft; reine Text-Instruct-Modelle wie Llama 3.3 70B Instruct sind nicht betroffen.

Fazit

Die Llama 3.3 Community License stellt eine forschungsfreundliche Sonderlizenz dar: Sie erlaubt Nutzung, Modifikation und Veröffentlichung unter klar definierten Bedingungen.

Für das Projekt meines virtuellen Pflege KI Instituts bedeutet das, dass Feintuning und wissenschaftliche Analysen zulässig sind, solange Attribution, Lizenzhinweis und Nutzungsrichtlinien eingehalten werden und keine kommerzielle Massenverwertung erfolgt.

Ausblick: Feintuning von Llama für die Pflegebegutachtung

Mit dem ersten Benchmark liegt nun ein belastbarer Vergleich zweier führender Large Language Models in der Pflegebegutachtung vor.

Die Ergebnisse zeigen, dass Llama 3.3 70B Instruct nicht nur eine solide Basis für Forschung im deutschsprachigen Gesundheitskontext bietet, sondern auch das Potenzial, durch gezieltes Feintuning zu einem pflegewissenschaftlich spezialisierten Sprachmodell für die Pflegebegutachtung weiterentwickelt zu werden.

Im nächsten Schritt plane ich, auf Grundlage des bestehenden Benchmark-Korpus ein Feintuning-Experiment durchzuführen,

um die inhaltliche Präzision, Domänenstabilität und Konsistenz in pflegerischen Entscheidungssituationen zu erhöhen.

Der Fokus liegt darauf, wie gut ein Modell pflegerisches Denken erfassen kann – also nicht nur Text versteht, sondern den dahinterliegenden pflegefachlichen Kontext korrekt interpretiert.

Für dieses Projekt soll Llama zu einem „Carereviewer Instruction Model“ verfeinert werden – einem KI-System, das in der Lage ist,

Entscheidungen bezogen auf die Pflegebegutachtung zu begründen, Wissen aus den Begutachtungsrichtlinien zu integrieren und pflegerische Bewertungen konsistent vorzunehmen.

Grundlage dafür bleibt der bestehende Benchmark-Katalog, der sukzessive erweitert und mit echten Fallbeispielen aus der Pflegebegutachtung angereichert wird.

Ich lade interessierte Forscherinnen und Forscher ein, sich an diesem Vorhaben zu beteiligen – sei es durch Datenaustausch,

methodische Anregungen oder gemeinsame Evaluation. Da das Repository derzeit nicht öffentlich zugänglich ist,

kann auf Anfrage individueller Zugriff für wissenschaftliche Kooperationen gewährt werden.

„Wenn KI künftig ganze Unternehmen leiten kann, warum nicht auch ein Institut für Pflegeforschung?“

Mit diesem Gedanken endet die erste Veröffentlichung meines virtuellen Pflege KI Instituts (das nicht immer ganz ernst gemeint ist, der Rest aber schon).

Sie markiert den Beginn einer längerfristigen Forschungsreihe, die das Zusammenspiel von Pflegewissenschaft, Pflegebegutachtung und Künstlicher Intelligenz systematisch untersucht – faktenbasiert, methodisch fundiert und mit einem Augenzwinkern gegenüber der Idee, dass auch Sprachmodelle wissenschaftlich arbeiten können.

Weitere Informationen, Einblicke in Datensätze und künftige Veröffentlichungen folgen auf

pflege-ai.de.

0 Kommentare