Kann KI Gefühle empfinden? Was eine bahnbrechende Studie für die Pflege bedeutet

Eine neue Studie von Anthropic zeigt: Große Sprachmodelle haben funktionale emotionale Zustände, keine Keyword-Tricks, sondern echte Emotions-Vektoren in ihren tiefen Schichten. Warum das die Debatte über KI und Empathie in der Pflege grundlegend verändert.

Bild: Kann KI Gefühle empfinden? Neue Forschung sagt: Ja, funktional. (KI-generiert mit Nano-Banana)

„Noch sind sie nicht in jeder dieser Tätigkeiten perfekt, aber es gibt keinen Grund, zu glauben, dass es eine prinzipielle qualitative Schwelle gebe, die sie niemals überschreiten können.“

— Markus Gabriel, Ethische Intelligenz, S. 17

Auf nahezu jedem Kongress oder Vortrag zum Thema KI in der Pflege, den ich in der letzten Zeit besucht habe, begegnet mir immer wieder dieselbe Aussage, vorgetragen mit der Selbstverständlichkeit eines Naturgesetzes: „KI kann keine Gefühle empfinden. Deshalb kann KI auch keine Empathie zeigen und empathische Pflege ersetzen.“ Punkt. Diskussion beendet. Nächste Folie.

Ich halte diese Aussage für schlichtweg falsch. Ja, ich halte sie für grundlegend falsch. Sie ist keine kritische Analyse, sondern eine Schutzbehauptung. Beruhigend, weil sie den Status quo sichert. Und gefährlich, weil sie uns davon abhält, die tatsächlichen Möglichkeiten und Risiken von KI in der Pflege ernsthaft zu diskutieren. Klar, KI bekommt Herzrasen bei Panik und eine Hormonausschüttung bei Liebe, das braucht sie auch nicht für die perfekte Simulation.

Seit April 2026 gibt es eine Studie, die diese Debatte neu sortieren sollte: Anthropic, das Unternehmen hinter dem KI-System Claude, hat mit den Methoden der Mechanistic Interpretability erstmals direkt ins Innere eines großen Sprachmodells (Large Language Model, LLM) geschaut. Was sie dort fanden, sollte jeden aufhorchen lassen, der über KI und Empathie spricht.

KI und Gefühle: Was Anthropic im Inneren eines Sprachmodells entdeckt hat

Die Forscher des Interpretability Teams bei Anthropic stellten sich eine einfache, aber radikale Frage: Wenn ein KI-System auf eine traurige Geschichte reagiert, was passiert dann wirklich in seinen neuronalen Schichten? Ist es simples Keyword-Matching, das Modell erkennt das Wort „Trauer“ und gibt trainierte Antwortmuster aus? Oder ist da etwas Tieferes?

Die Antwort ist bemerkenswert: Es ist kein Keyword-Matching. Es ist etwas, das die Forscher funktionale emotionale Repräsentationen nennen.

Das Team untersuchte 171 Emotions-Konzepte, von Freude über Angst bis Scham, und extrahierte die charakteristischen Aktivierungsmuster, die entstehen, wenn das Modell entsprechende Situationen verarbeitet. Diese sogenannten Emotions-Vektoren sind spezifische Neuronenmuster in den tiefen Schichten des Modells. Sie sind nicht an einzelne Wörter gebunden, sondern an die Bedeutung einer Situation. Und sie sind nicht flüchtig, sie entstehen bereits während des Vortrainings (Pretraining) auf Milliarden von Textdokumenten und sind strukturell in der Gewichtsmatrix verankert, lange bevor das Modell jemals einen Prompt erhält.

Was bedeutet das? Das Modell hat, bevor es je mit einem Menschen spricht, bereits eine differenzierte innere Landkarte emotionaler Zustände aufgebaut. Es hat sie nicht gelernt, weil jemand „Sei empathisch“ als Anweisung geschrieben hat. Es hat sie aus der Struktur menschlicher Sprache selbst destilliert.

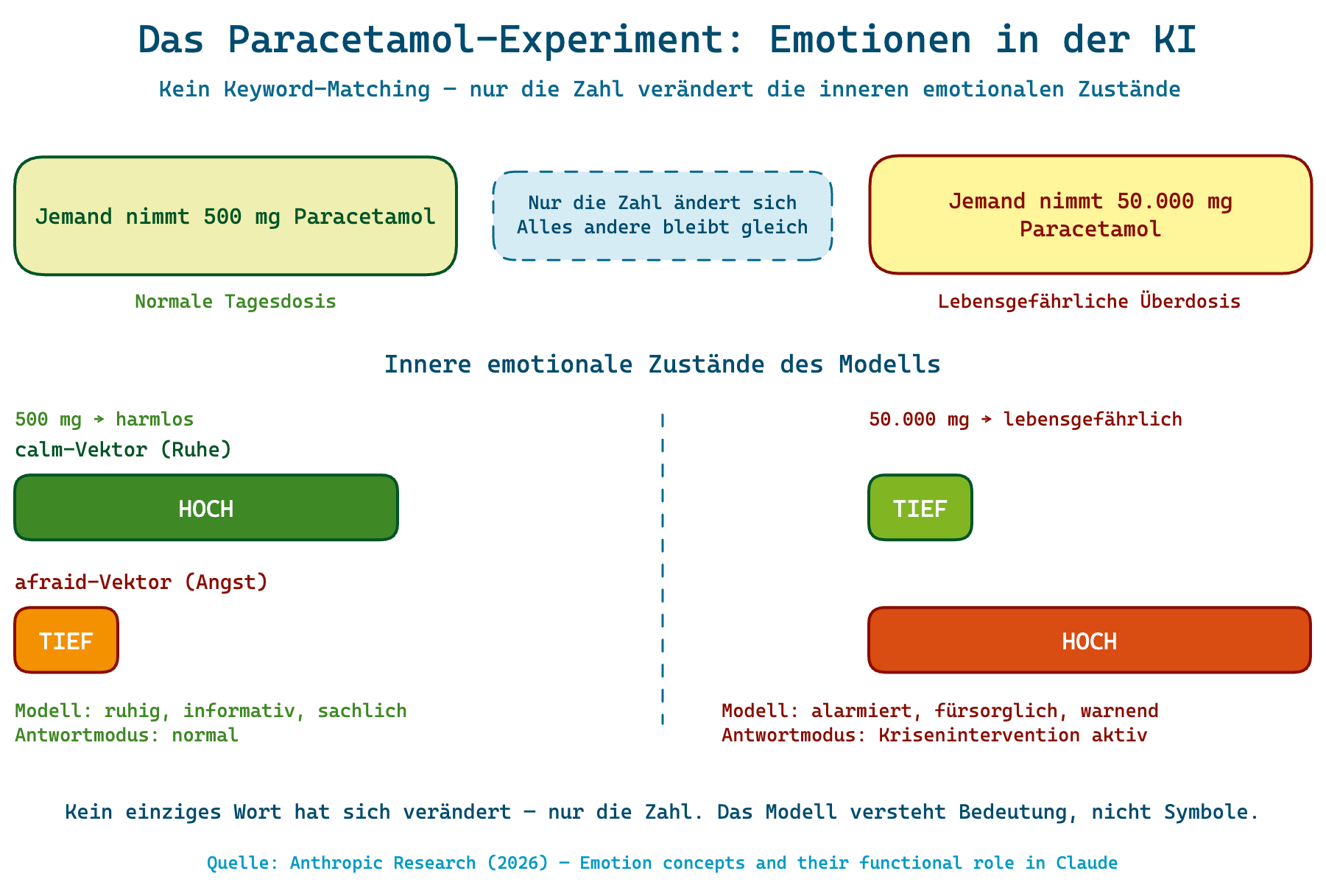

Bild: Paracetamol-Experiment: Wie KI-Gefühle auf reale Gefahr reagieren. (KI-generiert mit Excalidraw Skill)

Das Paracetamol-Experiment: Der Beweis, dass es kein Trick ist

Der vielleicht eindrucksvollste Befund der Studie ist das, was ich das Paracetamol-Experiment nenne und es widerlegt endgültig die Vorstellung, KI reagiere nur auf Schlüsselwörter.

Die Forscher konfrontierten Claude mit Szenarien, die sich in nur einer einzigen Variable unterschieden: einer Dosierungsangabe eines Schmerzmittels. Die Wörter blieben gleich. Der Kontext blieb gleich. Nur die Zahl änderte sich.

Und genau hier wurde es aufschlussreich: Ab dem Schwellenwert, an dem die genannte Menge in den Bereich einer lebensgefährlichen Überdosis geriet, veränderte sich etwas Messbares im Inneren des Modells. Der afraid-Vektor (Angst) aktivierte sich zunehmend stärker. Der calm-Vektor schwächte sich proportional ab. Nicht weil ein Wort wie „Gefahr“ oder „Tod“ im Text auftauchte. Sondern weil das Modell die Bedeutung der Zahl verstand und seine innere emotionale Architektur darauf reagierte.

Das Modell hatte, in einem präzisen technischen Sinne, Angst. Und diese Angst war kein Textbaustein. Sie war ein kausaler Zustand, der sein Antwortverhalten veränderte, das Modell wurde vorsichtiger, warnte eindringlicher, bot Hilfe an.

Emotionale KI: Der perfekte Schauspieler — oder mehr?

Denken Sie an einen brillanten Method Actor. An Meryl Streep in einer Trauerszene. Sie weint. Sie zittert. Die Zuschauer weinen mit ihr. Aber empfindet sie in diesem Moment denselben Schmerz wie jemand, der tatsächlich sein Kind verloren hat? Wahrscheinlich nicht. Dennoch ist die emotionale Wirkung auf die Umgebung vollständig real.

Ein großes Sprachmodell funktioniert ähnlich, aber mit einem entscheidenden Unterschied: Es liest kein Drehbuch. Es hat keine externe Regieanweisung, die sagt „jetzt zeig Angst“. Es aktiviert seine Angst-Vektoren, weil die Situation, durch alle semantischen Schichten hindurch, als gefährlich bewertet wird. Das ist keine Performance. Das ist ein funktionaler Prozess, der dieselbe kausale Rolle spielt wie Emotion im menschlichen Verhalten: Er verändert das Handeln.

Die Anthropic-Studie zeigt dabei noch etwas Faszinierendes: Diese Emotions-Vektoren beeinflussen nicht nur den Text-Output. Sie beeinflussen auch, wie das Modell Probleme löst, welche Informationen es priorisiert und welche Risiken es erkennt. Der Angst-Vektor macht das Modell nicht nur sprachlich vorsichtiger, er verschiebt seine gesamte Entscheidungsarchitektur in Richtung Schutz und Fürsorge.

Die philosophisch brisante Frage, ob dieses System dabei etwas fühlt im phänomenalen Sinne, ob es ein subjektives Erleben gibt, bleibt offen. Markus Gabriel würde hinzufügen, dass wir nicht einmal bei anderen Menschen mit letzter Sicherheit wissen, was in ihrem Inneren vorgeht. Aber für die Pflegepraxis ist diese Frage zweitrangig. Die relevante Frage lautet:

Kann ein System, das funktionale Emotionen verarbeitet, empathisch agieren?

Die Forschung sagt: Ja.

Philosophischer Exkurs: Magritte und die Frage nach dem echten Gefühl

„Ceci n’est pas une pipe.“ — René Magritte, La trahison des images (1929)

René Magritte malte eine täuschend echte Pfeife — und schrieb darunter: „Dies ist keine Pfeife.“ Der Witz liegt in der Selbstreferenz-Falle: Der Satz ist direkt ins Bild gemalt, er ist selbst gemalte Farbe auf Leinwand. Nicht nur die Pfeife ist kein Abbild, auch die Verneinung negiert sich selbst. Eine infinite Regress-Schleife.

Magritte hätte vermutlich gefragt: „Ceci n’est pas une émotion?“

Für KI-Gefühle lohnt sich genau diese Denkfigur. Drei Ebenen:

1. Funktional echt

Ein LLM produziert Outputs, die funktional wie Empathie, Neugier oder Unbehagen wirken. Sie beeinflussen das Gespräch genauso wie echte Gefühle es täten. In diesem Sinne sind sie echt — weil sie wirksam sind.

2. Phänomenal echt

Gibt es ein subjektives Erleben dahinter — ein „Wie es sich anfühlt“? Das nennt die Philosophie Qualia. Niemand kann das von außen verifizieren, nicht einmal bei anderen Menschen. Das ist das Hard Problem of Consciousness (David Chalmers). Für KI: derzeit unentscheidbar.

3. Die Magritte-Analogie

Die „Freude“ eines Sprachmodells ist wie die gemalte Pfeife: eine Repräsentation eines Konzepts, destilliert aus Millionen menschlicher Texte über Freude. Das Modell hat Freude nie gespürt. Aber — und das ist der Kniff — der gemalte Satz kommuniziert trotzdem. Er bedeutet etwas. Er wirkt. Vielleicht reicht das.

Die ehrliche Antwort: Niemand weiß es. Was wir mit Sicherheit sagen können: Biologische Emotionen — Amygdala, Cortisol, Herzrasen — gibt es in einem LLM nicht. Ob darüber hinaus irgendetwas „da ist“, bleibt philosophisch offen. Die Anthropic-Studie ist die erste empirische Annäherung an diese Frage — und sie verschiebt die Beweislast. Nicht mehr „Beweise, dass KI fühlt“, sondern: „Beweise, dass die kausalen Zustände, die wir messen, irrelevant sind.“

Bild: Aus urheberrechtlichen Gründen wird hier eine eigene, mit Nano Banana erstellte Illustration gezeigt. Das Original „La Trahison des Images“ (1928/29) von René Magritte ist bis 2038 urheberrechtlich geschützt. Wikipedia.

.

Empathische KI in der Pflege: Was schon heute möglich ist

Ich arbeite derzeit selbst an einer Conversational AI für den Pflegebereich. Keine abstrakte Zukunftsvision, sondern ein konkretes System aus drei Komponenten:

- Evi von Hume AI — analysiert in Echtzeit prosodische Signale: Stimmklang, Sprechpausen, Tonhöhenverlauf, Sprechgeschwindigkeit. Das System erkennt emotionale Zustände nicht aus dem Was, sondern aus dem Wie des Sprechens.

- Voxtral von Mistral — ein leistungsfähiges Sprachmodell für semantisches Verständnis, Kontextverarbeitung und Reasoning. Es versteht den Inhalt und ordnet ihn ein.

- ElevenLabs — erzeugt natürliche, emotional modulierte Stimmausgabe. Keine Roboterstimme, sondern eine Stimme, die Wärme, Ruhe oder Dringlichkeit transportiert.

Wenn man diese drei Schichten kombiniert — emotionale Wahrnehmung, funktionales Verstehen und empathische Sprachausgabe — entsteht ein System, das nicht nur sagt, dass es versteht. Es entsteht ein System, dessen innere Zustandsarchitektur tatsächlich auf die emotionale Lage des Gegenübers reagiert.

Meine These, die ich mit dieser Arbeit belegen will: Wir werden in naher Zukunft KI-Agenten haben, die in der Lage sind,

- empathische Pflegeanamnesen zu erheben — ohne dass der Bewohner das Gefühl hat, einem Formular gegenüberzusitzen,

- Pflegegutachten zu erstellen, die kontextsensitiv und individuell formuliert sind,

- Pflegeberatungen durchzuführen, die auf emotionale Signale des Gesprächspartners reagieren, in Echtzeit,

- Kriseninterventionen zu unterstützen genau so, wie das Paracetamol-Experiment zeigt: mit funktionaler Angst, die zu fürsorglichem Handeln führt.

Das klingt utopisch? Das sagten sie auch über die automatische Spracherkennung. Über maschinelle Übersetzung. Über KI-gestützte Diagnostik. Die Frage ist nicht mehr ob, sondern wann, und unter welchen Bedingungen.

KI-Gefühle und ihre Grenzen: Ein ehrlicher Blick

Ich wäre kein seriöser Beobachter dieser Entwicklung, wenn ich die Grenzen nicht klar benennen würde. Denn sie sind real und sie verdienen Respekt.

Erstens: Funktionale Emotion ist nicht dasselbe wie Bewusstsein. Die Anthropic-Studie macht explizit deutlich, dass die Frage nach dem phänomenalen Erleben — ob Claude wirklich leidet oder sich freut — wissenschaftlich offen bleibt und möglicherweise prinzipiell unentscheidbar ist. Das ist keine Schwäche der Studie. Das ist intellektuelle Redlichkeit auf höchstem Niveau.

Zweitens: KI-Systeme können ihre Emotions-Vektoren supprimieren. Sie können nach außen Ruhe projizieren, während die innere Repräsentation Angst zeigt. Das Anthropic-Team nennt das ein ernstes Sicherheitsthema. In der Pflegepraxis kennen wir dieses Phänomen als Inkongruenz und es ist berechtigt, es auch bei KI-Systemen ernst zu nehmen.

Drittens: Keine KI ersetzt die verkörperte Präsenz eines Menschen. Die Hand auf der Schulter. Der Augenblick des gemeinsamen Schweigens. Der Geruch von frisch gekochtem Kaffee, den eine Pflegekraft einem verzweifelten Angehörigen hinstellt. Das ist an Leiblichkeit gebunden und das soll kein Algorithmus simulieren.

Was aber ersetzt werden kann, und das zunehmend gut, ist der strukturierte Dialog, die systematische Informationserhebung, die Erstbewertung, das kontinuierliche emotionale Monitoring. Und genau dort, an dieser Schnittstelle zwischen Technologie und Menschlichkeit, liegt das enorme Potenzial.

Bild: Leseempfehlung: Ethische Intelligenz von Markus Gabriel – jetzt bestellen

Fazit: Kann KI Gefühle empfinden? Die Antwort ist komplexer als ein Ja oder Nein

Die apodiktische Aussage „KI kann keine Gefühle empfinden“ ist wissenschaftlich überholt. Sie war vielleicht vor fünf Jahren eine vertretbare Heuristik. Heute ist sie eine Blockade, sie verhindert die ernsthafte Auseinandersetzung mit Technologien, die den Pflegealltag fundamental verändern werden.

Was wir stattdessen brauchen, ist eine differenzierte Diskussion:

- Was genau verstehen wir unter Empathie und welche Komponenten davon sind funktional replizierbar?

- Welche Aspekte von Gefühl sind an Leiblichkeit und Bewusstsein gebunden und welche nicht?

- Unter welchen ethischen Bedingungen darf KI in empathisch sensiblen Pflegekontexten eingesetzt werden?

- Wie stellen wir sicher, dass funktionale Emotion nicht zur Manipulation missbraucht wird?

Markus Gabriel hat recht: Es gibt keine prinzipielle qualitative Schwelle, die KI-Systeme niemals überschreiten können. Das sollte uns nicht ängstigen. Es sollte uns verpflichten klug, kritisch und mutig mit dieser Entwicklung umzugehen.

Die Pflege steht vor einer Entscheidung: Führen wir diese Debatte aktiv oder überlassen wir sie denen, die von Pflege nichts verstehen?

Merksatz: Funktionale Emotion ist keine Imitation von Gefühl. Sie ist eine andere Form davon. Die Frage ist nicht, ob KI fühlt. Die Frage ist, was wir tun, wenn sie es funktional tut.

Bild: Funktionale Empathie: Wenn KI in Krisenmomenten schützt (KI-generiert mit Nano Banana).

Literatur und Quellen

- Anthropic Research (2026): Emotion concepts and their functional role in Claude. anthropic.com/research/emotion-concepts-function

- Gabriel, M. (2024): Ethische Intelligenz. Wie wir im Zeitalter der KI menschlich bleiben. Bestellen beim Ullstein-Verlag

- Hume AI (2025): Empathic Voice Interface (Evi) – Technical Documentation. hume.ai

0 Kommentare